Music Business

La ética del uso de voces clonadas o “deepfakes” en la música

Derechos de los artistas, innovación tecnológica y el desafío de la autenticidad en la era digital.

La tecnología de clonación de voces y de generación vocal mediante inteligencia artificial está transformando el panorama musical. Hoy es posible imitar timbres, inflexiones y estilos vocales de cantantes reconocidos, o incluso crear voces completamente nuevas a partir de pocos minutos de grabación.

Este avance amplía el horizonte creativo, pero también plantea dilemas éticos y jurídicos importantes: ¿es legítimo usar la voz de un artista sin su consentimiento? ¿qué ocurre cuando el público no puede distinguir entre una voz humana y una creada por máquina?

En este artículo analizamos el tema desde tres ejes: el consentimiento y los derechos del intérprete; la autenticidad artística; y el marco legal que comienza a definirse en distintas regiones, incluido América Latina.

1. Consentimiento y derechos de los artistas

El principio ético más básico del uso de voces clonadas es el consentimiento informado. La voz humana es una característica profundamente personal, un elemento identitario que conecta al artista con su público. Por eso, cuando se clona o manipula una voz sin autorización, surgen problemas éticos y legales graves.

- El derecho de publicidad (“right of publicity”) protege el uso comercial de la voz, imagen o nombre de una persona.

- Existen antecedentes de fraudes en los que voces clonadas por IA fueron usadas para suplantar identidades o vulnerar sistemas de seguridad.

- Los marcos de derechos de autor aún no se adaptan completamente a este tipo de tecnologías, como advierte la Oficina de Copyright de Estados Unidos.

Caso real

El tema cobró notoriedad con el sencillo “Heart on My Sleeve” (2023), que imitaba las voces de Drake y The Weeknd mediante IA. Universal Music Group denunció el uso no autorizado y exigió su retiro de plataformas, marcando uno de los primeros conflictos públicos entre artistas y “voces artificiales”.

Para evitar abusos, los proyectos que empleen voces generadas o clonadas deben incluir acuerdos contractuales claros, especificando quién autoriza el uso, con qué fines y cómo se distribuirán los beneficios.

2. Autenticidad y valor artístico

Más allá de los aspectos legales, surge un debate central: ¿qué significa “autenticidad” cuando la voz puede ser replicada digitalmente?

- La autenticidad vocal influye en cómo el público percibe la emoción y la conexión con una obra. Las herramientas de IA pueden reproducir el sonido, pero rara vez capturan la intención o la vulnerabilidad humanas.

- Existe el riesgo de que la proliferación de voces clonadas diluya el valor del intérprete como creador. Si todos pueden sonar igual, ¿qué define al artista?

- Sin embargo, también se abren posibilidades creativas: revivir voces de artistas fallecidos con autorización o generar colaboraciones imposibles. El límite ético está en la transparencia con el oyente.

Caso real

En comunidades online proliferan los covers creados con IA. Muchos fans los celebran, pero otros cuestionan: “No existe manera de hacer cumplir una ley que exija el consentimiento del artista antes de crear una versión artificial de su voz.”

El público tiene derecho a saber si una grabación utiliza IA. La transparencia —ya sea en los créditos, en los metadatos o en las plataformas— es clave para mantener la confianza y el respeto hacia la interpretación humana.

3. Marco legal y regulatorio

El uso de voces clonadas o deepfakes en la música involucra diversas áreas del derecho: propiedad intelectual, imagen, contratos y licencias tecnológicas.

- Algunos estudios señalan que la clonación vocal puede vulnerar derechos tanto en la fase de entrenamiento de la IA (cuando se usan grabaciones originales) como en la de producción (cuando se genera la voz final).

- En Estados Unidos, el estado de Tennessee aprobó la ELVIS Act (Ensuring Likeness, Image and Voice Security), una de las primeras leyes que protege la voz como elemento legalmente identificable.

- Plataformas musicales ya exigen licencias o eliminan contenidos generados con voces no autorizadas.

Panorama en América Latina

En países como Brasil, México o Argentina, aún no existe regulación específica sobre la clonación vocal, pero sí se aplican principios del derecho de imagen y del derecho moral del intérprete. Las asociaciones de músicos comienzan a recomendar cláusulas en los contratos que contemplen:

- autorización expresa para el uso de IA,

- reparto de regalías,

- y obligación de informar si la voz fue alterada digitalmente.

El desafío para la región es anticipar los vacíos legales. Las empresas del sector deberían actualizar sus contratos y capacitar a artistas y productores sobre las implicaciones éticas y jurídicas del uso de IA.

4. Guía práctica para un uso ético de la IA vocal

- Consentimiento escrito del titular de la voz, especificando su uso y contexto.

- Transparencia pública: indicar cuándo una voz fue generada o modificada por IA.

- Participación en regalías si la voz clonada se usa con fines comerciales.

- Verificar licencias de las herramientas de IA utilizadas.

- No reemplazar intérpretes humanos en contextos donde el valor artístico dependa de la autenticidad.

- Actualizar contratos y políticas internas para incluir cláusulas de voz generada por IA.

- Monitorear la legislación internacional para adaptar buenas prácticas locales.

- Educar al público y a la prensa sobre el concepto de “voz clonada” para evitar desinformación.

La clonación vocal y los deepfakes abren una nueva frontera en la creación musical. Pueden impulsar la innovación, pero también poner en riesgo la identidad artística y los derechos de los intérpretes.

Como advierte el sitio Kits.AI: “Uno de los principales dilemas éticos es el consentimiento. La voz es uno de los atributos más únicos e irrepetibles de una persona.”

En última instancia, el éxito de estas tecnologías dependerá de equilibrar creatividad, ética y seguridad jurídica. Las publicaciones y medios especializados tienen el deber de liderar el debate sobre cómo la IA puede coexistir con la integridad artística y el respeto hacia quienes dan voz —literalmente— a la música.

Music Business

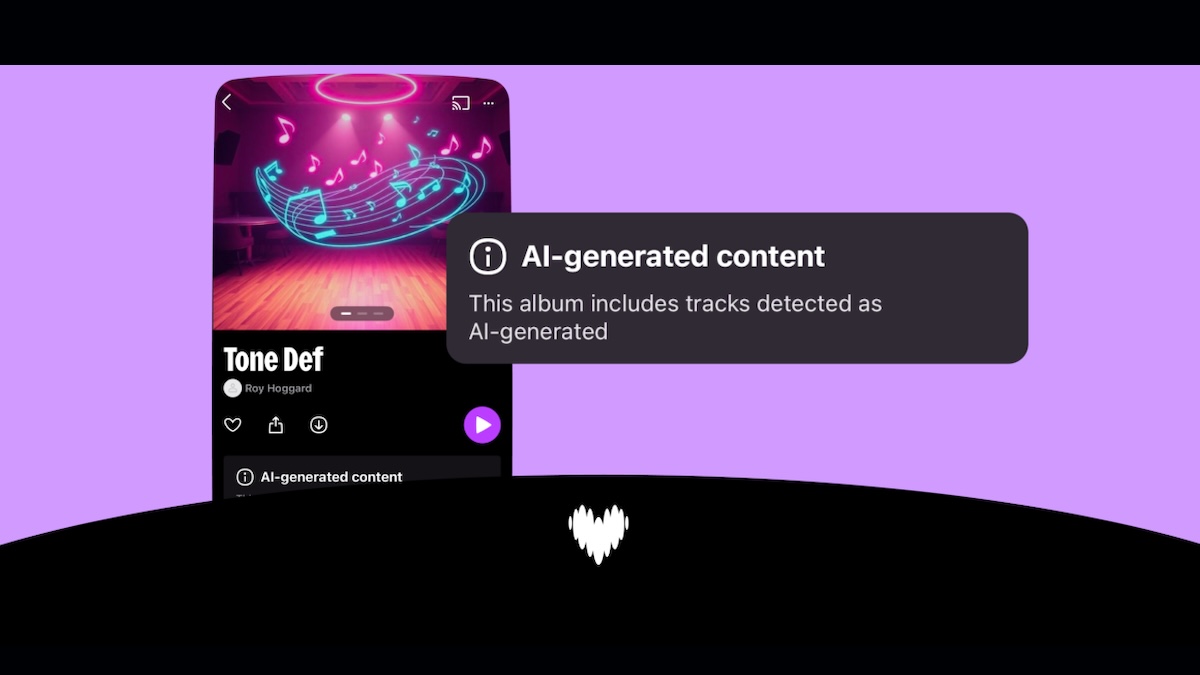

Deezer frena fraudes con música creada por IA y abre su tecnología al mercado

Deezer confirma la desmonetización masiva de música generada por IA y pone su tecnología antifraude a disposición de la industria.

Deezer dio un paso firme en el debate global sobre música generada por inteligencia artificial. La plataforma confirmó que hasta el 85% de los streams asociados a canciones creadas por IA fueron desmonetizados tras ser identificados como fraudulentos, y anunció que comenzará a comercializar su tecnología propietaria de detección para otros actores del mercado musical.

Según datos de la propia plataforma, solo en 2025 se detectaron más de 13,4 millones de pistas generadas por IA, con un promedio de 60 mil nuevos uploads diarios, lo que representa cerca del 39% de todo el contenido recibido cada día. Aunque este tipo de música responde a apenas hasta el 3% del total de reproducciones, la tasa de fraude asociada es significativamente mayor que en el resto del catálogo: hasta 85%, frente a un promedio de 8% en canciones creadas por humanos.

“La música generada íntegramente por IA se ha vuelto casi indistinguible de la creación humana”, afirmó Alexis Lanternier, CEO de Deezer. “Nuestra postura es clara: transparencia para los oyentes y protección de los derechos de artistas y compositores. Detectamos estas canciones, las etiquetamos, las excluimos de las recomendaciones algorítmicas y desmonetizamos cada reproducción fraudulenta”.

Además de retirar estos contenidos del fondo de regalías, Deezer decidió licenciar su tecnología de detección por IApara sellos, entidades de gestión y otros jugadores del sector. La herramienta ya fue probada con éxito por organizaciones como la Sacem, la sociedad francesa de autores y compositores.

“Existe un interés real del mercado por este tipo de soluciones”, agregó Lanternier. “Queremos que esta tecnología esté disponible para toda la industria y ayude a reducir los incentivos a la fraude masiva”.

Para América Latina, el anuncio también tiene impacto directo. Rodrigo Vicentini, General Manager de Deezer para la región, destacó que la iniciativa busca equilibrar innovación tecnológica y sostenibilidad del ecosistema musical: “Estamos comprometidos con traer al mercado herramientas que protejan a quienes crean y refuercen la creatividad humana como eje central del streaming”.

Music Business

Moises lanza AI Studio, una plataforma de IA que genera instrumentales adaptados a la música del artista

La nueva herramienta online crea stems inteligentes y acelera la producción musical manteniendo al creador en control.

Moises anunció el lanzamiento de AI Studio, un editor de audio online con inteligencia artificial y funciones generativas integradas. A diferencia de otras plataformas de IA que crean canciones completas a partir de simples indicaciones, AI Studio adopta un enfoque basado en stems, generando partes instrumentales individuales —como líneas de bajo, baterías o guitarras— que se adaptan automáticamente al sonido, tempo, armonía y estilo de la grabación original del usuario.

La plataforma actúa como un “compañero de banda” virtual, que escucha la base creada por el músico y responde con arreglos coherentes, facilitando la experimentación y la construcción de ideas sin desplazar al artista del centro del proceso creativo.

Los modelos de IA de AI Studio están entrenados con grabaciones aisladas y de alta calidad de instrumentos, y no con pistas finales ya masterizadas. Esto permite un control preciso sobre cada elemento del arreglo, acercando la experiencia a la de trabajar con músicos de estudio.

“Estamos presentando un enfoque fundamentalmente distinto para la creación musical con IA. AI Studio fue diseñado para la colaboración”, afirma Geraldo Ramos, CEO y cofundador de Moises. “Es como tener un compañero de banda que entiende de inmediato tu visión musical y responde con la parte instrumental adecuada”.

Producción musical directamente en el navegador

AI Studio funciona completamente en el navegador, sin necesidad de descargas ni equipamiento especializado, e integra herramientas como:

- Generación de stems con IA, sensible al contexto

- Separación de stems de voces e instrumentos a partir de audio mixto

- Conversión de voz con IA, con más de 50 voces de calidad de estudio

- Mezcla y masterización automáticas

- Edición de audio online, sin flujos de trabajo complejos

Cada stem puede ser editado de forma inteligente, adaptándose a cambios de dinámica y estructura. Los usuarios pueden aplicar presets por género, ajustar el “feeling” de cada parte y completar secciones o transiciones con un solo clic.

Tecnología consolidada y disponibilidad

El lanzamiento se basa en la trayectoria de Moises, una plataforma utilizada por más de 65 millones de músicos en todo el mundo y reconocida como App del Año para iPad por Apple en 2024. AI Studio llega tras la ronda de inversión de US$ 50 millones anunciada en enero de 2025 por Music.AI, startup detrás de la aplicación, liderada por Connect Ventures y monashees.

El AI Studio ya está disponible para todos los usuarios de Moises en los planes Free, Premium y Pro, con créditos mensuales incluidos y la opción de adquirir créditos adicionales. Los suscriptores Pro cuentan además con acceso a funciones avanzadas de generación.

Music Business

¿Vale la pena estudiar producción musical hoy?

La producción musical vive uno de los momentos más dinámicos de su historia.

Nunca hubo tantas herramientas disponibles, tantos creadores activos ni tantas oportunidades para que una canción llegue a audiencias globales. Pero al mismo tiempo, el mercado es competitivo, cambiante y exige habilidades que van mucho más allá de saber usar una DAW.

En este contexto surge la pregunta: ¿vale la pena estudiar producción musical hoy? La respuesta es sí, pero con matices. Y aquí exploramos por qué.

La democratización del estudio casero cambió el panorama

Hace 20 años, producir una canción requería estudios costosos y equipos inaccesibles para la mayoría. Hoy, con una computadora portátil, un par de monitores y un buen conjunto de plugins, cualquier persona puede comenzar a crear música desde su habitación.

Esto generó dos efectos importantes:

- Más oportunidades de expresión creativa, independientemente del presupuesto.

- Mayor competencia, ya que miles de productores emergentes suben música todos los días.

Estudiar producción es hoy una forma de destacar en un mar de creadores.

La formación profesional sigue siendo una ventaja

Aunque muchos productores son autodidactas, la educación formal —ya sea una carrera, diplomado, curso especializado o certificación— aporta algo que YouTube no puede dar por sí solo:

- Bases sólidas de teoría y audio

- Herramientas de análisis crítico

- Metodologías de trabajo

- Retroalimentación profesional

- Contactos clave en la industria

En un mercado saturado, el conocimiento profundo sigue siendo un factor que abre puertas.

La industria musical es más grande que nunca

El streaming impulsó un crecimiento récord en la música global. Esto abrió nuevas áreas para los productores:

- Música para artistas

- Música para videojuegos

- Publicidad y contenido digital

- Sonido para cine y TV

- Creación de samples y librerías

- Educación musical online

El productor de hoy no solo trabaja en discos: trabaja en ecosistemas de audio.

La demanda por habilidades híbridas aumenta

Estudiar producción musical hoy no es solo aprender a grabar una voz. La industria necesita profesionales que dominen varias habilidades:

- Beatmaking

- Mezcla y mastering

- Edición de audio y corrección vocal

- Programación MIDI

- Diseño sonoro

- Música para multimedia

- Gestión de proyectos

- Distribución y marketing digital

Quien se prepara bien puede ocupar múltiples roles y generar ingresos diversificados.

Inteligencia Artificial: ¿amenaza o herramienta?

La llegada de herramientas de IA generativa, como asistentes de mezcla, composición y mastering automático, generó debates intensos.

Pero la realidad es clara: la IA no reemplaza a los productores; reemplaza a quienes no aportan valor creativo.

Saber estudiar, entender y dominar estas herramientas permite:

- Trabajar más rápido

- Experimentar más

- Aumentar la calidad de las maquetas

- Reducir tiempos de edición

- Optimizar flujos de trabajo

Quienes aprendan a integrar la IA a sus procesos estarán mejor posicionados.

¿Y la parte económica?

Es una pregunta legítima: ¿se puede vivir de la producción musical?

Sí, pero no siempre a través de un único camino. Los productores exitosos suelen combinar:

- Trabajo con artistas

- Servicios de mezcla / mastering

- Comisiones para cine, TV y publicidad

- Creación de beats y sample packs

- Contenido educativo (clases, cursos, Patreon)

- Presentaciones en vivo

- Sonido para videojuegos

El error es pensar que la producción musical se limita a “hacer canciones para otros”. Hoy es una profesión con múltiples modelos de negocio.

Entonces… ¿vale la pena estudiar producción musical hoy?

Definitivamente sí, siempre que exista:

- Una motivación real

- Disciplina para practicar

- Apertura para aprender nuevas tecnologías

- Disposición para adaptarse a distintos mercados

- Paciencia para construir una red de contactos y una reputación

La producción musical es una carrera creativa y técnica, pero también es un camino de aprendizaje continuo. Quienes se capacitan y se mantienen actualizados encuentran un espacio sólido en una industria que no deja de crecer.

Estudiar producción musical es una inversión en un futuro creativo

La música sigue siendo una necesidad humana, y los productores son quienes dan forma a esa expresión.

Con la preparación adecuada, el productor de hoy tiene más oportunidades que nunca para dejar su huella, vivir de su arte y construir una carrera sostenible.

-

Audio6 meses ago

Audio6 meses agoConecta+: Electro-Voice lanza EVIVA, una nueva familia de altavoces

-

Audio6 meses ago

Audio6 meses agoArgentina: Sennheiser redefine su distribución y sella alianza con Todomúsica

-

Audio7 meses ago

Audio7 meses agoColombia: Montarbo en Provenco 2025 EXPO: Innovación sonora desde Italia hasta Cartagena

-

Audio4 meses ago

Audio4 meses agoGus Lozada asume nuevo cargo en M-Audio / inMusic Brands

-

instrumentos musicales3 meses ago

instrumentos musicales3 meses agoLas guitarras más vendidas en el mundo en 2025 y qué tendencias explican su éxito

-

Eventos5 meses ago

Eventos5 meses agoMusic China 2025 reunirá a 1.600 expositores en Shanghái y apuesta por la resiliencia y la diversidad

-

Iluminación5 meses ago

Iluminación5 meses agoElation y Apart Productions en el escenario principal del UNTOLD Festival

-

Audio6 meses ago

Audio6 meses agoPreSonus tiene nueva línea de mixers digitales StudioLive SE con grabación avanzada y conectividad MILAN